Düşük Gecikme ve Yüksek Veri Akışı için Go Mikroservislerini Optimize Etme

Giriş

Go (Golang), mükemmel concurrency modeli, verimli bellek yönetimi ve derlenmiş doğası nedeniyle mikroservis oluşturmak için popüler bir seçenek haline gelmiştir. Ancak, hem gecikme süresi (latency) hem de veri işleme hızı (throughput) açısından optimum performans elde etmek, mimari, kodlama modelleri ve sistem düzeyinde optimizasyonların dikkatle ele alınmasını gerektirir. Bu makale, Go mikroservislerini en yüksek performans için optimize etmeye yönelik kapsamlı stratejileri incelemektedir.

Gecikme ve Veri İşleme Hızını Anlamak

Optimizasyonlara dalmadan önce, neyi optimize ettiğimizi anlamak önemlidir:

- Gecikme (Latency): Tek bir isteğin işlenmesi için geçen süre (ms veya μs olarak ölçülür)

- Veri İşleme Hızı (Throughput): Belirli bir zaman diliminde işlenebilen istek sayısı (saniyedeki istek sayısı olarak ölçülür)

Bu metrikler genellikle karmaşık bir ilişkiye sahiptir - birini optimize etmek bazen diğerini olumsuz etkileyebilir. Amacımız, belirli kullanım senaryoları için optimum dengeyi bulmaktır.

Temel Go Optimizasyonları

1. Go’nun Concurrency Modelini Kullanma

Go’nun goroutine’leri ve channel’ları, minimal yük ile güçlü bir eşzamanlı programlama modeli sağlar.

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

|

// Kötü: Sıralı işleme

func ProcessRequests(requests []Request) []Response {

responses := make([]Response, len(requests))

for i, req := range requests {

responses[i] = processRequest(req)

}

return responses

}

// İyi: Goroutine'ler ile eşzamanlı işleme

func ProcessRequestsConcurrently(requests []Request) []Response {

responses := make([]Response, len(requests))

var wg sync.WaitGroup

for i, req := range requests {

wg.Add(1)

go func(i int, req Request) {

defer wg.Done()

responses[i] = processRequest(req)

}(i, req)

}

wg.Wait()

return responses

}

|

2. Worker Pool Pattern

Birçok isteği işlemek için, concurrency’yi sınırlamak ve kaynak tükenmesini önlemek için bir worker pool uygulayın:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

|

func WorkerPool(tasks []Task, numWorkers int) []Result {

results := make([]Result, len(tasks))

jobs := make(chan int, len(tasks))

var wg sync.WaitGroup

// Worker'ları başlat

for w := 0; w < numWorkers; w++ {

wg.Add(1)

go worker(w, tasks, results, jobs, &wg)

}

// Worker'lara işleri gönder

for j := range tasks {

jobs <- j

}

close(jobs)

// Tüm worker'ların işi bitirmesini bekle

wg.Wait()

return results

}

func worker(id int, tasks []Task, results []Result, jobs <-chan int, wg *sync.WaitGroup) {

defer wg.Done()

for j := range jobs {

results[j] = executeTask(tasks[j])

}

}

|

1. Redis’i Cache olarak Kullanma

Yüksek performanslı bir key-value store olarak Redis, Go mikroservislerinizin performansını önemli ölçüde artırabilir.

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

|

type RedisCache struct {

client *redis.Client

expiration time.Duration

}

func NewRedisCache(addr string, expiration time.Duration) *RedisCache {

client := redis.NewClient(&redis.Options{

Addr: addr,

Password: "", // Redis şifresi (varsa)

DB: 0, // Kullanılacak veritabanı

PoolSize: 100, // Connection pool boyutu

})

return &RedisCache{

client: client,

expiration: expiration,

}

}

func (c *RedisCache) Get(key string, value interface{}) error {

data, err := c.client.Get(context.Background(), key).Bytes()

if err != nil {

return err

}

return json.Unmarshal(data, value)

}

func (c *RedisCache) Set(key string, value interface{}) error {

data, err := json.Marshal(value)

if err != nil {

return err

}

return c.client.Set(context.Background(), key, data, c.expiration).Err()

}

|

2. Redis ile Rate Limiting Uygulama

Mikroservislerinizi aşırı yükten korumak için Redis tabanlı rate limiting:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

|

func NewRedisRateLimiter(redisClient *redis.Client, limit int, window time.Duration) *RedisRateLimiter {

return &RedisRateLimiter{

client: redisClient,

limit: limit,

window: window,

}

}

func (l *RedisRateLimiter) Allow(key string) (bool, error) {

now := time.Now().UnixNano()

windowStart := now - l.window.Nanoseconds()

pipe := l.client.Pipeline()

// Pencere dışındaki istekleri kaldır

pipe.ZRemRangeByScore(context.Background(), key, "0", strconv.FormatInt(windowStart, 10))

// Mevcut penceredeki istek sayısını al

countCmd := pipe.ZCard(context.Background(), key)

// Yeni isteği ekle

pipe.ZAdd(context.Background(), key, &redis.Z{Score: float64(now), Member: now})

// Anahtara süre sonu belirle

pipe.Expire(context.Background(), key, l.window)

_, err := pipe.Exec(context.Background())

if err != nil {

return false, err

}

count := countCmd.Val()

return count <= int64(l.limit), nil

}

|

3. Redis ile Distributed Locking

Mikroservisler arasında koordinasyon sağlamak için Redis kullanarak distributed locking mekanizması:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

|

type RedisLock struct {

client *redis.Client

key string

value string

expiration time.Duration

}

func NewRedisLock(client *redis.Client, resource string, expiration time.Duration) *RedisLock {

return &RedisLock{

client: client,

key: fmt.Sprintf("lock:%s", resource),

value: uuid.New().String(),

expiration: expiration,

}

}

func (l *RedisLock) Acquire() (bool, error) {

return l.client.SetNX(context.Background(), l.key, l.value, l.expiration).Result()

}

func (l *RedisLock) Release() error {

script := redis.NewScript(`

if redis.call("GET", KEYS[1]) == ARGV[1] then

return redis.call("DEL", KEYS[1])

else

return 0

end

`)

_, err := script.Run(context.Background(), l.client, []string{l.key}, l.value).Result()

return err

}

|

4. Redis ile Gelişmiş Caching Stratejileri

Redis’in yerleşik veri yapılarını kullanarak verimli ve karmaşık caching stratejileri uygulama:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

|

type MultiLevelCache struct {

local *ristretto.Cache // Yerel bellek cache (Ristretto)

redis *redis.Client // Redis cache

localTTL time.Duration

redisTTL time.Duration

}

func NewMultiLevelCache(redisAddr string) (*MultiLevelCache, error) {

// Yerel cache yapılandırması

localCache, err := ristretto.NewCache(&ristretto.Config{

NumCounters: 1e7, // Yaklaşık 10M öğeyi izle

MaxCost: 1 << 30, // 1GB'a kadar kullan

BufferItems: 64, // Varsayılan değer

})

if err != nil {

return nil, err

}

// Redis client

redisClient := redis.NewClient(&redis.Options{

Addr: redisAddr,

PoolSize: 100,

})

return &MultiLevelCache{

local: localCache,

redis: redisClient,

localTTL: 1 * time.Minute, // Yerel cache süresi

redisTTL: 10 * time.Minute, // Redis cache süresi

}, nil

}

func (c *MultiLevelCache) Get(key string, value interface{}) (bool, error) {

// Önce yerel cache'i kontrol et

if val, found := c.local.Get(key); found {

err := json.Unmarshal(val.([]byte), value)

return true, err

}

// Yerel cache'de bulunamazsa, Redis'i kontrol et

val, err := c.redis.Get(context.Background(), key).Bytes()

if err == nil {

// Redis'te bulundu, yerel cache'e de ekle

err = json.Unmarshal(val, value)

if err == nil {

c.local.SetWithTTL(key, val, 1, c.localTTL)

}

return true, err

} else if err != redis.Nil {

// Redis hatası

return false, err

}

// Hiçbir yerde bulunamadı

return false, nil

}

func (c *MultiLevelCache) Set(key string, value interface{}) error {

// JSON'a dönüştür

data, err := json.Marshal(value)

if err != nil {

return err

}

// Önce Redis'e kaydet

err = c.redis.Set(context.Background(), key, data, c.redisTTL).Err()

if err != nil {

return err

}

// Sonra yerel cache'e ekle

c.local.SetWithTTL(key, data, 1, c.localTTL)

return nil

}

func (c *MultiLevelCache) Delete(key string) error {

// Önce Redis'ten sil

err := c.redis.Del(context.Background(), key).Err()

// Yerel cache'den de sil

c.local.Del(key)

return err

}

|

5. Redis Pub/Sub ile Mikroservisler Arası İletişim

Redis’in Pub/Sub özelliği, Go mikroservisleri arasında hafif ve hızlı bir iletişim mekanizması sağlar:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

|

type RedisPubSub struct {

client *redis.Client

}

func NewRedisPubSub(addr string) *RedisPubSub {

client := redis.NewClient(&redis.Options{

Addr: addr,

PoolSize: 100,

})

return &RedisPubSub{

client: client,

}

}

func (ps *RedisPubSub) Publish(channel string, message interface{}) error {

data, err := json.Marshal(message)

if err != nil {

return err

}

return ps.client.Publish(context.Background(), channel, data).Err()

}

func (ps *RedisPubSub) Subscribe(channel string, handler func([]byte)) error {

pubsub := ps.client.Subscribe(context.Background(), channel)

defer pubsub.Close()

// Mesajları işlemek için bir goroutine başlat

ch := pubsub.Channel()

for msg := range ch {

handler([]byte(msg.Payload))

}

return nil

}

// Kullanım örneği:

func StartSubscriber(ps *RedisPubSub) {

go func() {

err := ps.Subscribe("orders", func(data []byte) {

var order Order

if err := json.Unmarshal(data, &order); err == nil {

processOrder(order)

}

})

if err != nil {

log.Fatalf("Subscribe hatası: %v", err)

}

}()

}

|

Bellek Optimizasyon Teknikleri

1. Object Pooling

Garbage collection baskısını azaltmak için nesneleri yeniden kullanma:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

|

var bufferPool = sync.Pool{

New: func() interface{} {

return new(bytes.Buffer)

},

}

func ProcessWithPool() {

buf := bufferPool.Get().(*bytes.Buffer)

defer func() {

buf.Reset()

bufferPool.Put(buf)

}()

// İşleme için buf kullan...

}

|

2. Bellek Ayırmalarını Azaltma

Gereksiz bellek ayırma işlemlerini azaltarak garbage collection yükünü en aza indirme:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

|

// Kötü: Her çağrıda yeni bir dilim oluşturur

func BadAppend(data []int, value int) []int {

return append(data, value)

}

// İyi: Dilimi kapasiteyle önceden ayırır

func GoodAppend(data []int, values ...int) []int {

if cap(data) < len(data)+len(values) {

newData := make([]int, len(data), len(data)+len(values)+100) // Ekstra kapasite

copy(newData, data)

data = newData

}

return append(data, values...)

}

|

Redis and Caching Strateji karşılaştırması

Ağ Optimizasyonu

1. Connection Pooling

Yeni bağlantılar kurmanın yükünü azaltmak için bağlantıları yeniden kullanma:

1

2

3

4

5

6

7

8

|

var httpClient = &http.Client{

Transport: &http.Transport{

MaxIdleConns: 100,

MaxIdleConnsPerHost: 100,

IdleConnTimeout: 90 * time.Second,

},

Timeout: 10 * time.Second,

}

|

2. HTTP/2 ve gRPC Kullanımı

HTTP/2 ve gRPC önemli performans avantajları sunar:

- Tek bir bağlantı üzerinden birden fazla isteğin çoğullanması

- Header sıkıştırma

- İkili protokol verimliliği

1

2

3

4

5

6

7

8

9

|

func NewGRPCServer() *grpc.Server {

return grpc.NewServer(

grpc.KeepaliveParams(keepalive.ServerParameters{

MaxConnectionIdle: 5 * time.Minute,

Time: 20 * time.Second,

Timeout: 1 * time.Second,

}),

)

}

|

Veritabanı Optimizasyonları

1. Connection Pooling

1

2

3

4

5

6

7

8

9

|

db, err := sql.Open("postgres", connectionString)

if err != nil {

log.Fatal(err)

}

// Connection pool parametrelerini yapılandır

db.SetMaxOpenConns(25)

db.SetMaxIdleConns(25)

db.SetConnMaxLifetime(5 * time.Minute)

|

2. Batch Processing

Veritabanına yapılan gidiş-gelişleri azaltma:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

|

// Tek bir sorgu ile birden fazla kaydı ekle

func BatchInsert(users []User) error {

query := "INSERT INTO users(id, name, email) VALUES "

vals := []interface{}{}

for i, user := range users {

query += fmt.Sprintf("($%d, $%d, $%d),", i*3+1, i*3+2, i*3+3)

vals = append(vals, user.ID, user.Name, user.Email)

}

query = query[:len(query)-1] // Sondaki virgülü kaldır

_, err := db.Exec(query, vals...)

return err

}

|

Sistem Düzeyinde Optimizasyonlar

1. CPU Profiling ve Optimizasyon

Go’nun yerleşik profiling araçlarını kullanarak darboğazları belirleme:

1

|

go tool pprof http://localhost:6060/debug/pprof/profile

|

2. İşletim Sistemi Parametrelerinin Ayarlanması

Ağ yoğun uygulamalar için sistem ayarlarını düzenleyin:

1

|

sysctl -w net.core.somaxconn=65535

|

Service Mesh ve Load Balancing

Akıllı istek yönlendirme ve yük dengelemeyi uygulayın:

İzleme ve Gözlemlenebilirlik

Darboğazları belirlemek için kapsamlı telemetri uygulama:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

|

func instrumentHandler(next http.Handler) http.Handler {

return http.HandlerFunc(func(w http.ResponseWriter, r *http.Request) {

start := time.Now()

// Durum kodunu yakalamak için ResponseWriter'ı sarmala

ww := middleware.NewWrapResponseWriter(w, r.ProtoMajor)

// Handler'ı çalıştır

next.ServeHTTP(ww, r)

// Metrikleri kaydet

duration := time.Since(start).Milliseconds()

requestsTotal.WithLabelValues(r.Method, r.URL.Path, strconv.Itoa(ww.Status())).Inc()

requestDuration.WithLabelValues(r.Method, r.URL.Path).Observe(float64(duration))

})

}

|

Çeşitli yükler altında servis performansını tutarlı bir şekilde test edin:

1

2

3

4

5

6

7

8

9

10

11

12

13

|

func BenchmarkEndpoint(b *testing.B) {

server := httptest.NewServer(NewAPIHandler())

defer server.Close()

b.ResetTimer()

for i := 0; i < b.N; i++ {

resp, err := http.Get(server.URL + "/api/resource")

if err != nil {

b.Fatal(err)

}

resp.Body.Close()

}

}

|

Aşağıda çeşitli optimizasyonların tipik bir Go mikro servisi üzerindeki etkisinin görselleştirilmesi yer almaktadır:

Redis Dağıtık Sistem Mimarisi

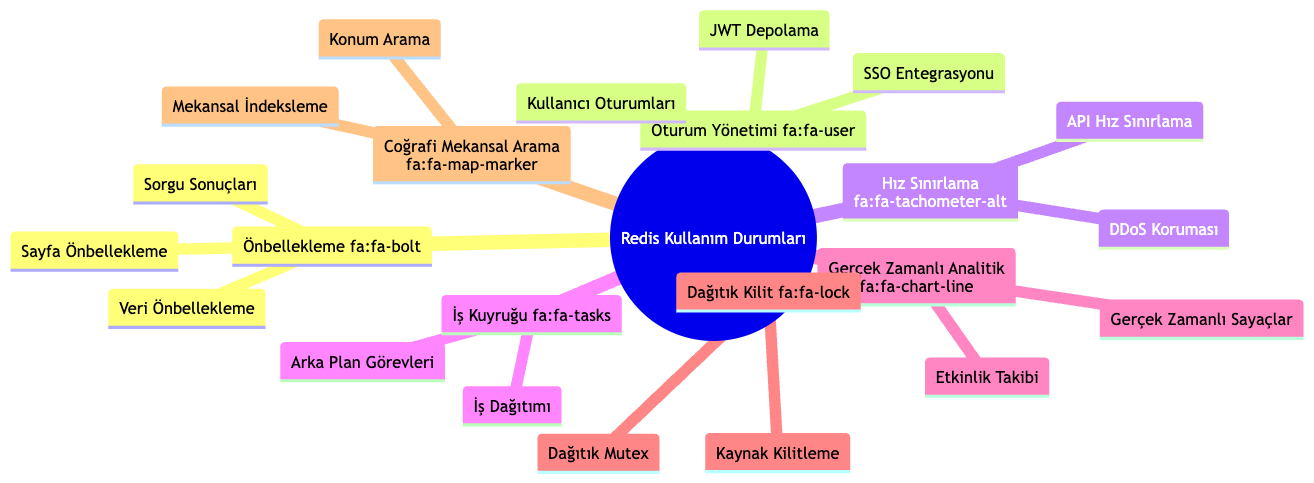

Redis Kullanım Durumları

Sonuç

Düşük gecikme ve yüksek veri akışı için Go mikroservislerini optimize etmek, çok yönlü bir yaklaşım gerektirir. Redis, bu optimizasyon stratejilerinde kritik bir bileşen olarak öne çıkar:

- Go’nun goroutine’ler ve channel’lar ile concurrency modelini kullanın

- Pooling ile verimli bellek yönetimi uygulayın

- Bağlantı yeniden kullanımı ve modern protokoller ile ağ iletişimlerini optimize edin

- Redis ile çok seviyeli caching stratejileri uygulayın:

- Yerel bellek cache (ilk savunma hattı)

- Redis cache (dağıtık, ölçeklenebilir ikinci seviye)

- Veri tutarlılığını sağlamak için cache invalidation mekanizmaları

Redis’in sadece caching için değil, aynı zamanda şunlar için de kullanılabileceğini unutmayın:

- Rate limiting

- Session management

- Distributed locking

- Mikroservisler arası iletişim (Pub/Sub)

- Job queuing

Uygun veritabanı erişim modellerini kullanın

Servislerinizi sürekli olarak izleyin ve performans testlerini yapın

En etkili optimizasyon stratejisi, bu teknikleri belirli iş yükü özelliklerinize ve darboğazlarınıza göre birleştirmeyi gerektirir. Gereksiz karmaşıklığa yol açabilecek erken optimizasyonlardan kaçının – her zaman değişikliklerden önce ve sonra performansı ölçerek gerçek iyileştirmeler yaptığınızdan emin olun.

Redis’i mikroservis mimarinize entegre ederken, aşağıdaki faktörleri göz önünde bulundurun:

- Caching Stratejisi: Hangi verilerin cache’leneceği, ne kadar süreyle ve nasıl geçersiz kılınacağı

- Bellek Yönetimi: Redis bellek kullanımını ve çıkarma politikalarını dikkatle yapılandırın

- Ölçeklenebilirlik: Yüksek kullanılabilirlik ve ölçeklenebilirlik için Redis Sentinel veya Redis Cluster kullanın

- Dayanıklılık: Veri kalıcılığı gereksinimleri için AOF ve RDB ayarlarını yapılandırın

Bu stratejileri uygulayarak, yüksek yükleri minimum gecikme ile işleyebilen, ölçeklenebilir ve olağanüstü performans sunan Go mikroservisleri geliştirebilirsiniz. Redis’in stratejik kullanımı, gecikme sürelerini önemli ölçüde azaltabilir ve servislerinizin ölçeklenebilirliğini önemli ölçüde artırabilir.